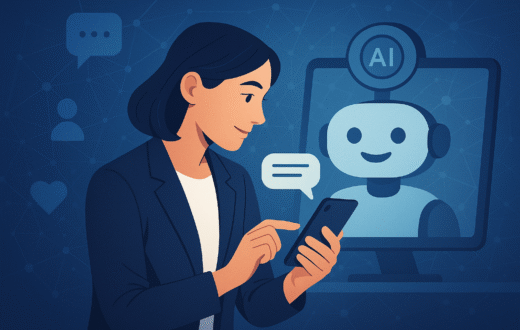

الروبوتات العلاجية بالذكاء الاصطناعي: قيود قانونية جديدة في 2025

في عام 2025، أصدرت ثلاث ولايات أمريكية هي يوتا، نيفادا، وإلينوي تشريعات مهمة تحد من دور روبوتات المحادثة بالذكاء الاصطناعي في مجال الرعاية النفسية. هذه القوانين تمنع استخدام الذكاء الاصطناعي في تقديم العلاج أو التشخيص أو اتخاذ القرارات العلاجية، لكنها تسمح باستخدامه في المهام الإدارية مثل جدولة المواعيد وتوثيق الملفات. بدأت القوانين تدريجيًا: في يوتا بتاريخ 7 مايو، نيفادا في 1 يوليو، وإلينوي في 4 أغسطس. وفي إلينوي، يمكن فرض غرامات تصل إلى 10,000 دولار لكل مخالفة.

برّر المشرّعون هذه الخطوة بضرورة حماية المرضى ورسم حدود واضحة بين الأدوات الإدارية والممارسات العلاجية. قانون نيفادا يمنع أي نظام ذكاء اصطناعي من تقديم خدمات الصحة النفسية، بينما يفرض قانون يوتا اشتراطات للشفافية، حماية الخصوصية، وتوضيح القيود لمنع الروبوتات من تقليد الأخصائيين المرخصين. هذه الإجراءات تعكس القلق من خطورة اعتماد أدوات غير مُختبرة على مستخدمين في مواقف ضعف أو أزمات.

رؤية الطلاب والبحث الأكاديمي

في جامعة فلوريدا الدولية، أجرى كل من الدكتورة جيسيكا كيزوريك والدكتور أوتيس كوب أبحاثًا حول علاقة الطلاب بالذكاء الاصطناعي. أظهرت النتائج أن الطلاب يشعرون بالقلق من احتمال أن يستبدل الذكاء الاصطناعي الوظائف ويقلّص الفرص للخريجين. بعضهم عبّر عن مخاوف من الاعتماد المفرط على هذه الأدوات، مما قد يضعف التفكير النقدي وحل المشكلات. كما طرحوا تساؤلات حول كيفية الموازنة بين الحكم البشري والمساعدة التقنية. هذا الجدل يشبه النقاش في العلاج النفسي، حيث يفتقر الذكاء الاصطناعي إلى التعاطف والمسؤولية المهنية لكنه قد يكون مفيدًا في أنشطة مثل الكتابة التأملية، اليقظة الذهنية، والإبداع.

تأثير القوانين على الجامعات

هذه التشريعات تؤثر أيضًا على التدريب الأكاديمي. طلاب علم النفس والإرشاد في ولايتي إلينوي ونيفادا لن يتمكنوا من استخدام الروبوتات العلاجية في مراكز الجامعة، بينما تسمح يوتا بتجارب محدودة ومنظمة. ونتيجة لذلك، سيركّز الطلاب بشكل أكبر على الأخلاقيات والسياسات والرقابة بدلاً من الممارسة العلاجية المباشرة.

مراكز الإرشاد الجامعية ما زالت تعتمد أساسًا على الخدمات البشرية، مع إمكانية الاستفادة من الذكاء الاصطناعي في بعض المهام الخلفية مثل النماذج الأولية وجدولة المواعيد. لكن مسألة المسؤولية القانونية لا تزال غير محسومة: فإذا استخدم الطالب روبوتًا خارج إطار الجامعة، غالبًا ما تقع المسؤولية على الشركة المطوّرة إلا إذا أوصى مختص مرخص باستخدامه.

المشهد الوطني

ولايات أخرى مثل نيوجيرسي، ماساتشوستس، وكاليفورنيا تدرس تشريعات مشابهة. وعلى المستوى الفيدرالي، قد تقوم جهات مثل إدارة الغذاء والدواء الأمريكية (FDA) بوضع معايير وطنية مستقبلًا، لكن النقاش لا يزال مفتوحًا. وهناك مشروع قانون مقترح يمنع الولايات من سنّ تشريعات جديدة حول الذكاء الاصطناعي لمدة عشر سنوات، مما يخلق توترًا بين السلطات المحلية والفيدرالية.

الخلاصة

هذه القوانين لا تعني رفض التكنولوجيا، بل تهدف إلى تحديد مكانها الصحيح. في الوقت الحالي، يقتصر دور الذكاء الاصطناعي على المهام الإدارية، البحث العلمي، والاستخدام الشخصي للتأمل والراحة، بينما تبقى العناية العلاجية مسؤولية الأخصائيين المرخّصين. بالنسبة لطلاب علم النفس والإرشاد، فإن اختيار الولاية التي يدرسون فيها سيحدد مستوى تعرضهم لهذه الأدوات وكيفية تعلمهم التوازن بين الابتكار، التنظيم، والرعاية الإنسانية.